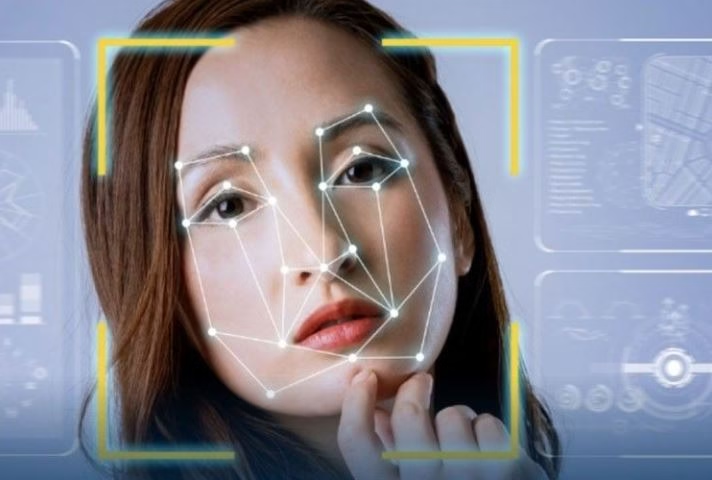

O termo deepfake deriva da junção de deep learning (aprendizado profundo) com fake (falso), e refere-se a conteúdos audiovisuais manipulados por meio de algoritmos de inteligência artificial, que aprendem padrões faciais, vocais e corporais para simular de forma realista a aparência ou a voz de uma pessoa.

Ao contrário de edições tradicionais, os deepfakes criam resultados quase indistinguíveis da realidade, o que amplia sua capacidade de enganar.

Um exemplo clássico de deepfake é a inserção do rosto de uma celebridade no corpo de outra pessoa, fazendo parecer que ela protagonizou determinada situação, disse algo que nunca dissera ou participou de um evento inexistente. Esses conteúdos podem ser utilizados para fins cômicos, artísticos ou educativos — mas também para práticas ilícitas como chantagem, difamação, manipulação política, fraude e abuso.

Quais os principais riscos jurídicos dos Deepfakes?

A criação e disseminação de deepfakes levanta uma série de questionamentos jurídicos, que vão desde a tutela da imagem até a responsabilização civil e penal dos autores.

Dentre os principais riscos, destaca-se primeiramente a violação de direitos da personalidade, notadamente quando há o uso indevido da imagem, voz ou expressão corporal de alguém. Mesmo em ambiente virtual, configura violação ao direito à imagem, à honra e à privacidade, conforme previsto no artigo 5º, incisos V e X, da Constituição Federal e nos artigos 11 a 21 do Código Civil.

Além disso, quando o conteúdo falso gera consequências negativas — como perda de emprego, exposição vexatória ou danos à reputação —, a vítima poderá pleitear indenização pelos prejuízos sofridos, com base na responsabilidade civil subjetiva ou objetiva, a depender do contexto.

A divulgação de um deepfake com conteúdo ofensivo, também pode configurar crime contra a honra, nos termos dos artigos 138 a 140 do Código Penal, especialmente se houver intenção dolosa de prejudicar a reputação da vítima.

Em situações mais graves, deepfakes podem ser utilizados para fraudar contratos, simular depoimentos, induzir autoridades a erro ou enganar o público em geral. Nesses casos, enquadram-se nos tipos penais de estelionato, falsidade documental ou ideológica, entre outros.

O uso de deepfakes em campanhas políticas ou contextos eleitorais levanta debates sobre abuso de poder econômico, desinformação e comprometimento da lisura democrática. Não por acaso, a Justiça Eleitoral já sinaliza preocupação com o tema, especialmente com a proximidade de novas eleições.

O ordenamento jurídico brasileiro está preparado?

A legislação brasileira ainda não possui um dispositivo específico sobre deepfakes, o que impõe ao intérprete do Direito a necessidade de aplicar normas gerais por analogia.

Ainda assim, diversos instrumentos legais permitem uma resposta razoável ao fenômeno:

O Marco Civil da Internet (Lei nº 12.965/2014) estabelece princípios para uso da internet no Brasil, incluindo a responsabilização de plataformas por danos decorrentes de conteúdo de terceiros, desde que notificados judicialmente.

A Lei Geral de Proteção de Dados Pessoais – LGPD (Lei nº 13.709/2018) protege dados biométricos, como rostos e vozes, considerados sensíveis. O uso não autorizado desses dados em deepfakes pode ser interpretado como violação da LGPD.

O Código Civil, em seus artigos sobre responsabilidade civil, oferece base para pleitos indenizatórios, tanto por violação da imagem quanto por atos ilícitos.

O Código Penal, como visto, contempla diversos tipos aplicáveis, ainda que de forma genérica.

Apesar disso, a ausência de um marco normativo específico gera insegurança jurídica, sobretudo em relação à identificação dos autores, à responsabilização de plataformas e à eficácia das medidas reparatórias ou preventivas.

Caminhos possíveis: regulação, educação digital e responsabilidade compartilhada

O enfrentamento jurídico e social dos deepfakes exige muito mais do que reações pontuais ou medidas exclusivamente repressivas, pois a complexidade do fenômeno — que une avanços tecnológicos, manipulação de informações e impactos reais sobre direitos fundamentais — demanda uma abordagem estruturada, preventiva e multidisciplinar.

Nesse cenário, é fundamental que se compreenda que não há solução única ou mágica, mas sim uma conjugação de esforços baseados na regulação adequada, na educação digital e na assunção de responsabilidades compartilhadas por todos os atores envolvidos.

A regulação surge como um dos pilares centrais dessa resposta.

Embora o ordenamento jurídico brasileiro já conte com dispositivos capazes de amparar vítimas de manipulações digitais, como a proteção da imagem, a responsabilização civil e penal , e as normas de proteção de dados pessoais, torna-se cada vez mais evidente a necessidade de atualização normativa específica.

Essa atualização não deve ser orientada pelo pânico moral ou por uma tentativa de criminalizar a tecnologia em si, mas sim por critérios técnicos e jurídicos que garantam segurança, previsibilidade e proporcionalidade. A criação de marcos legais específicos sobre conteúdos sintéticos, mecanismos de rastreabilidade e autenticação de mídia, e deveres de transparência para plataformas tecnológicas é uma etapa importante nesse processo, desde que conduzida com respeito aos princípios constitucionais da liberdade de expressão, da proporcionalidade e da legalidade estrita.

Paralelamente à regulação, é imprescindível investir em educação digital, uma vez que, em uma sociedade cada vez mais conectada e visualmente orientada, a capacidade crítica dos cidadãos para distinguir entre o que é real e o que é fabricado torna-se uma competência essencial

Por fim, a responsabilidade não pode ser atribuída exclusivamente ao Estado ou ao usuário final.

As plataformas digitais, desenvolvedoras de inteligência artificial, empresas de mídia e demais agentes do ecossistema digital têm papel fundamental na mitigação dos riscos associados aos deepfakes, já que, ainda que o Marco Civil da Internet limite a responsabilização automática por conteúdos de terceiros, cresce a expectativa de que essas plataformas adotem mecanismos preventivos e responsivos, como sistemas de verificação de autenticidade, detecção automatizada de manipulação e canais eficazes de remoção de conteúdo abusivo, sendo esperado uma atuação com transparência, fornecendo aos usuários informações claras sobre os riscos de disseminação de deepfakes e as políticas de moderação em vigor.

Ao reconhecer que a proteção contra os deepfakes depende de uma cadeia de corresponsabilidade, reforça-se uma visão mais madura e sistêmica do Direito na era digital.

Os deepfakes representam um novo capítulo no já complexo debate entre tecnologia, liberdade e responsabilidade. Ao mesmo tempo em que ampliam as possibilidades de criação e expressão, abrem perigosas portas para abusos que desafiam o direito à verdade, à privacidade e à reputação.

O enfrentamento jurídico desse fenômeno exigirá, mais do que novos códigos ou penas severas, um esforço coordenado entre legisladores, juristas, empresas de tecnologia, educadores e a própria sociedade civil.

O desafio é construir um ambiente digital mais seguro, sem sufocar a liberdade criativa — e, sobretudo, garantir que o uso da tecnologia continue sendo um instrumento de progresso e não de opressão.

Mariane Galbine

Advogada com 8 anos de experiência na área cível e empresarial, é sócia da área cível do escritório Almeida Prado Hoffmann Advogados Associados. Tem pós-graduação em Direito Processual Civil e em Direito Societário, além de Especialização em Prática Cível Forense, Inteligência Artificial aplicada ao Direito, Proteção Contratual no CDC e Certificação Internacional na Lei de Proteção de Dados. Membro da Comissão Permanente das Mulheres Advogadas da OAB – SP.